Replicación entre dos HP EVA 4400 con Continuous Access

Continuous Access, es la replicación nativa de las cabines HP StorageWorks Enterprise Virtual Array Family (EVA). Veremos la configuración necesaria tanto a nivell de Switch de SAN como a nivell de Command View (CV) para realizar replicación sincrona o asincrona (dependiento de las ubicaciones por exemple).

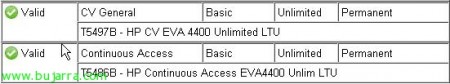

No puedo empezar sin antes mencionar que para realizar este tipo de replicación es necesario disponer de licenciamiento específico (segun las especificaciones de tu EVA…), és a dir, si tenemos una licencia de CV para 4Tb y deseamos replicarlos, deberemos adquirir una licencia de Continuous Access de 4Tb.

En el meu cas: (licencia ilimitada tanto en CV como en CA 🙂 )

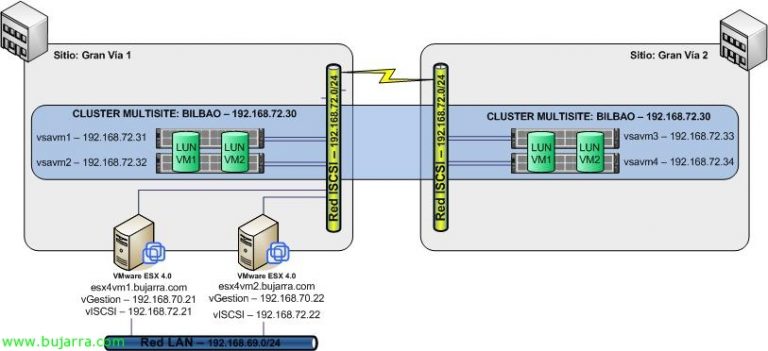

Said esto, os presento el entorno a configurar: dos CPDs en un mateix edificio (A, B) con dos switches de fibra en cada uno (11 y 12, 21 y 22). En cada CPD, dos HP EVA's 4400 amb un sol grup de discos (12HD 300Gb de fibra); a més, un servidor que exercirà de Command View en cada CPD (CV_A i CV_B) i per acabar, una infraestructura de virtualització dividida entre els dos CPDs (4 ESX en CPD A i 2 ESX en CPD B, amb un sol vCenter al servidor CV_A. Totes les fibres passen per un doble camí excepte els dos servidors 'CV'’ que disposen d'una sola HBA.

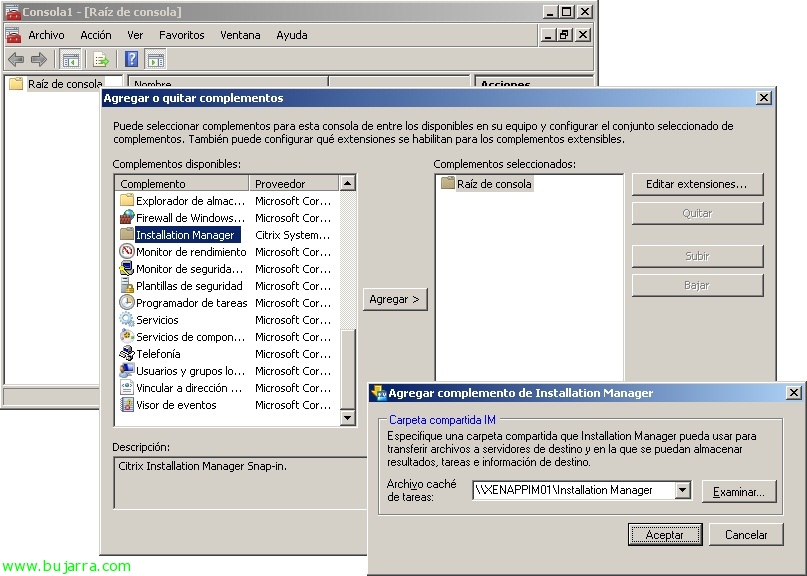

Amb la infraestructura presentada, el primer que hem de fer és configurar correctament el zoning dels switches de fibra perquè els dos CV siguin capaços de veure la cabina del CPD contrari. Això és un requisit per realitzar la replicació; així que en finalitzar, disposarem de dos CV des d'on podem administrar les nostres dues EVAs.

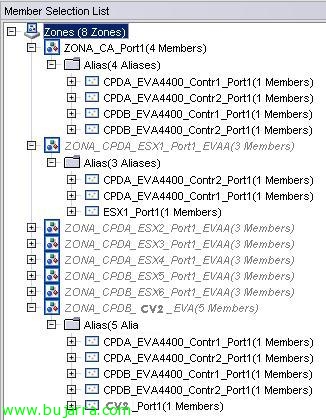

Al Switch 11 (el primer del CPD A), tinc configurades les següents zones:

- ZONA_CA_Port1: És la zona que conté els ports 1 de ambdues controladores de ambdues EVA.

- ZONA_CPDA_ESX'x'_Port1_EVAA: És la zona que conté la primera HBA de l'ESX1 amb accés als ports 1 de ambdues controladores de l'EVA del CPD A.

- ZONA_CPDB_CV2_EVA: És la zona on dono permisos al CV2 als ports 1 de ambdues controladores de ambdues EVA.

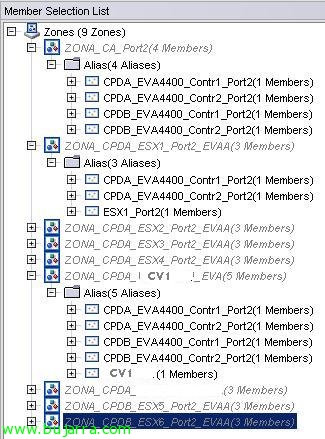

Al Switch 12 (el segon del CPD A), tinc configurades les següents zones: (Aquest switch és el que té connectat el CV1)

- ZONA_CA_Port2: És la zona que conté els ports 2 de ambdues controladores de ambdues EVA.

- ZONA_CPDA_ESX'x'_Port2_EVAA: És la zona que conté la segona HBA de l'ESX'x’ amb accés als ports 2 de ambdues controladores de l'EVA del CPD A.

- ZONA_CPDB_CV1_EVA: És la zona on dono permisos al CV1 als ports 2 de ambdues controladores de ambdues EVA.

Al Switch 21 (el primer del CPD B), tinc configurades les següents zones: (Aquest switch és el que té connectat el CV2)

- ZONA_CA_Port1: És la zona que conté els ports 2 de ambdues controladores de ambdues EVA.

- ZONA_CPDA_ESX'x'_Port1_EVAA: És la zona que conté la primera HBA de l'ESX'x’ amb accés als ports 1 de ambdues controladores de l'EVA del CPD A.

- ZONA_CPDB_CV2_EVA: És la zona on dono permisos al CV2 als ports 2 de ambdues controladores de ambdues EVA.

Al Switch 22 (el segon del CPD B), tinc configurades les següents zones:

- ZONA_CA_Port2: És la zona que conté els ports 2 de ambdues controladores de ambdues EVA.

- ZONA_CPDA_ESX'x'_Port2_EVAA: És la zona que conté la primera HBA de l'ESX'x’ amb accés als ports 2 de ambdues controladores de l'EVA del CPD A.

- ZONA_CPDB_CV1_EVA: És la zona on dono permisos al CV1 als ports 2 de ambdues controladores de ambdues EVA.

Cal mencionar, que l'ideal, es permitir a las zones de los ESX el accés a los ports de la EVA del CPD B, así si tuvieramos que pasar la infraestructura a trabajar contra la EVA del CPD B, tendriamos la mitad del trabajo hecho.

Con la configuración de zoning anterior, conseguimos que los CV de dos CPDs sean capaces de administrar las dos EVAs com se mostra en la imatge.

Lo primer que tendremos que configurar para empezar a replicar, es un DR Group o Data Replication Group. En estos, deberemos agrupar aquellas LUNs del mateix tipo; en el meu cas, tengo varias LUN que sirven como DataStores en VMware por lo que crearé un únic DRGroup para dichas LUNs.

Per a això, pincharemos sobre “Data Replication” y “Create Data Replication Group”.

En la primera parte, tenemos el nom del DRG, el origen que pren per defecte és l'EVA des d'on estàs creant el grup de replicació. El destinació, marcarem l'EVA a la qual volem replicar… com en el meu cas només en tinc dues, no tinc possibilitat de fallida… El Vdisk d'origen, és la LUN que desitgem replicar. (cada LUN només pot estar en un DRGroup)

A la segona part, digues que tenim les opcions “avançades”:

- Mode d'escriptura: Mode d'escriptura, síncron o asíncron:

- Synchronous. Aquest mode proporciona la millor protecció de dades. En mode d'escriptura síncron, l'array reconeix la finalització de l'E/S després que les dades estiguin emmagatzemades a l'array d'origen i destinació. Aquest procés manté dades idèntiques en un grup DR d'origen i en el seu grup DR de destinació en tot moment.

- Asynchronous. Aquest mode proporciona el millor rendiment de l'E/S de l'amfitrió. En mode d'escriptura asíncron, la matriu d'origen reconeix les escriptures de l'amfitrió abans que les dades es repliquin a la matriu de destinació. Aquest procés permet un E/S d'amfitrió més ràpid que el mode sincrònic. Des d'un punt de vista de protecció de dades, poden existir breus instàncies en què les dades no siguin idèntiques al grup DR d'origen i de destinació. El mode d'escriptura asíncrona pot ser basic o millorat, segons la versió del programari del controlador.

- Grup de discs de destinació: Grupo de discos de destino. En el meu cas, com que només tinc una safata de discs per EVA, només tinc un grup de discs.

- Redundància de destinació: Podem modificar el nivell de RAID del destinació o deixar com a l'origen…

- Accés de l'amfitrió de destinació: podem establir el nivell d'accés que tindrà la LUN…

- Mida del registre: Tamaño de LOG. ¡¡ATENCIÓ!! La mida del registre per defecte a partir del firm 9.0.0 és de 102,40Gb. Los logs se guardan con una redundància RAID1 y en les dos cabines així que ojito con l'espai que tenis disponible… yo lo he establecido en 10240Mb… que me parece más que suficiente.

- Source Log Disk Group: El grupo de disco donde se guarden los LOGs en el origen. Esto podria ser útil si tenim dos grups de discos amb diferents coenxiones. FIBRA frente a FATA por ejemplo.

- Grup de Discs de Registre de Destinació: El grupo de disco donde se guarden los LOGs en el origen.

- Failsafe on unavail member: La protecció de dades Failsafe és una funció que bloqueja l'E/S de l'host a tots els discs virtuals d'un grup de DR quan els components fallen o es tornen indisponibles. Aquesta funcionalitat protegeix les dades mantenint l'ordre d'escriptura en els grups de DR d'origen i destinació. (no hya mejor explicación)…

- Suspend on links down: Suspende la rèplica si algun link se encuentra en estado Down.

- Suspend on full copy: Si esta ‘enable’ la replicacion remota se suspende cuando se lanza una ‘full copy’.

- comments: No comments…

una vez elegidas las opciones, arriba le pulsaremos sobre “Create” y empezará la primera ‘full copy’. Cuidado cuando lo lanzais puesto que puede repercutir en el rendimiento del sistema…

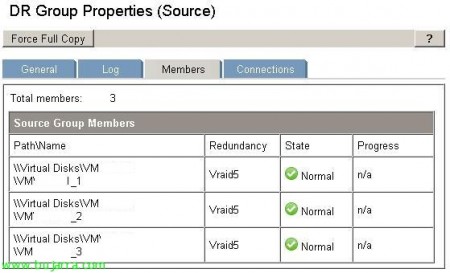

Una vez creado y terminada la primera replica, si hemos seleccionado el modo de escritura sincrono estará en continuo cambio “origen-destino”. No obstant això,, seleccionando el DRGroup en cuestion y navengando por las pestañas que aparecen en la imagen, podemos volver a cambiar todas las opciones que se dan en el momento de su creación. Ademas de ver el estado de la replica…

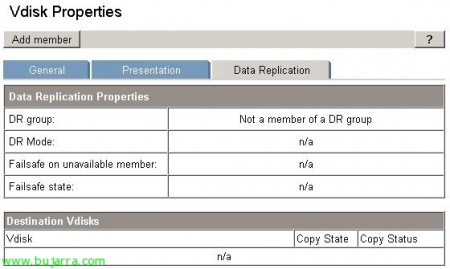

Si quiesieramos añadir una LUN a un DRGroup ya creado, lo tendremos que hacer desde las propiedades de la LUN sobre la pestaña de DataReplication, Add member.

- DR Group: Nos permite indicar algun de los DRG ya creados

- Destination disk group: el grupo de discos de destino

- Destination redundancy level: El nivell de RAID en el destino.

Podriem tambien des d'aquí, saltar a crear un DRG nuevo, con el boton “Create DR group”…

Así es como se muestra la pestañana Members de un DRGroup con 3 LUNs replicando.