两个 HP EVA 之间的复制 4400 带 Continuous Access

持续访问, 是 HP StorageWorks 企业虚拟阵列系列机柜的原生复制功能 (EVA). 我们将查看在 SAN 交换机级别以及 Command View 级别所需的配置 (CV) 以实现同步或异步复制 (取决于例如位置).

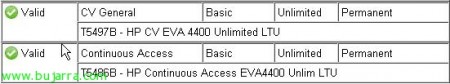

No puedo empezar sin antes mencionar que para realizar este tipo de replicación es necesario disponer de licenciamiento específico (segun las especificaciones de tu EVA…), 我的意思是, si tenemos una licencia de CV para 4Tb y deseamos replicarlos, deberemos adquirir una licencia de Continuous Access de 4Tb.

就我而言: (licencia ilimitada tanto en CV como en CA 🙂 )

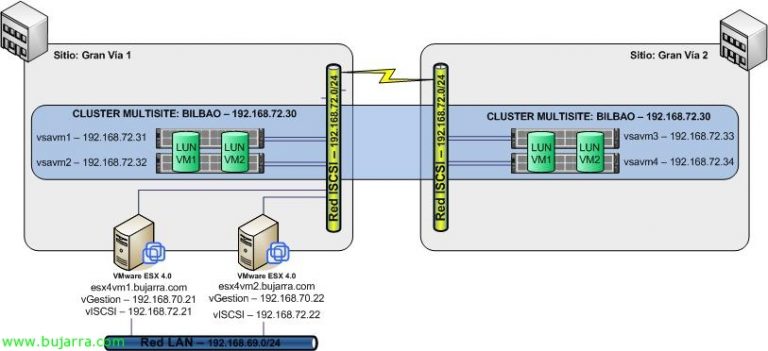

Dicho esto, os presento el entorno a configurar: dos CPDs en un mismo edificio (自, B) con dos switches de fibra en cada uno (11 和 12, 21 和 22). En cada CPD, dos HP EVA’s 4400 con un solo grupo de discos (12HD 300Gb de fibra); 另外, un servidor que ejercerá de Command View en cada CPD (CV_A y CV_B) 最后, una infraestructura de virtualización dividida entre los dos CPDs (4 ESX en CPD A y 2 ESX en CPD B, con un solo vCenter en el servidor CV_A. Todas las fibras van por doble camino a excepción de los dos servidores ‘CV’ que disponen de una sola HBA.

Con la infraestructura presentada, lo primero que debemos hacer es configurar correctamente el zoning de los switches de fibra para que los dos CV sean capaces de ver la cabina del CPD contrario. Esto es un requisito para realizar la replicación; así que al finalizar, dispondremos de dos CV desde donde podemos administrar nuestras dos EVAs.

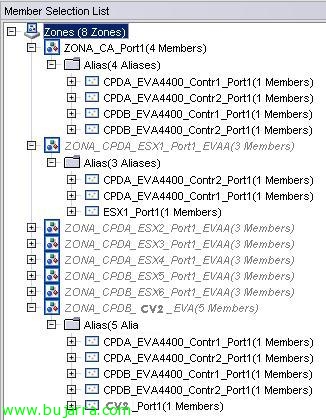

En el Switch 11 (el primero del CPD A), tengo configuradas las siguientes zonas:

- ZONA_CA_Port1: Es la zona que contiene los puertos 1 de ambas controladoras de ambas EVAs.

- ZONA_CPDA_ESX’x’_Port1_EVAA: Es la zona que contiene la primera HBA del ESX1 con acceso a los puertos 1 de ambas controladoras de la EVA del CPD A.

- ZONA_CPDB_CV2_EVA: Es la zona donde doy permisos al CV2 a los puertos 1 de ambas controladoras de ambas EVAs.

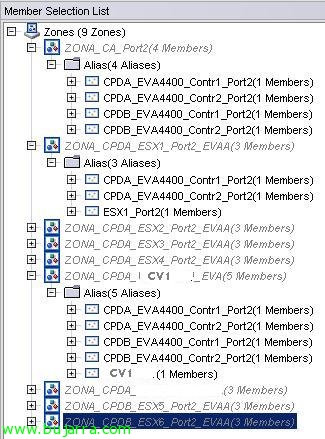

En el Switch 12 (el segundo del CPD A), tengo configuradas las siguientes zonas: (Este switch es el que tiene conectado el CV1)

- ZONA_CA_Port2: Es la zona que contiene los puertos 2 de ambas controladoras de ambas EVAs.

- ZONA_CPDA_ESX’x’_Port2_EVAA: Es la zona que contiene la segunda HBA del ESX’x’ con acceso a los puertos 2 de ambas controladoras de la EVA del CPD A.

- ZONA_CPDB_CV1_EVA: Es la zona donde doy permisos al CV1 a los puertos 2 de ambas controladoras de ambas EVAs.

En el Switch 21 (el primero del CPD B), tengo configuradas las siguientes zonas: (Este switch es el que tiene conectado el CV2)

- ZONA_CA_Port1: Es la zona que contiene los puertos 2 de ambas controladoras de ambas EVAs.

- ZONA_CPDA_ESX’x’_Port1_EVAA: Es la zona que contiene la primera HBA del ESX’x’ con acceso a los puertos 1 de ambas controladoras de la EVA del CPD A.

- ZONA_CPDB_CV2_EVA: Es la zona donde doy permisos al CV2 a los puertos 2 de ambas controladoras de ambas EVAs.

En el Switch 22 (el segundo del CPD B), tengo configuradas las siguientes zonas:

- ZONA_CA_Port2: Es la zona que contiene los puertos 2 de ambas controladoras de ambas EVAs.

- ZONA_CPDA_ESX’x’_Port2_EVAA: Es la zona que contiene la primera HBA del ESX’x’ con acceso a los puertos 2 de ambas controladoras de la EVA del CPD A.

- ZONA_CPDB_CV1_EVA: Es la zona donde doy permisos al CV1 a los puertos 2 de ambas controladoras de ambas EVAs.

Hay que mencionar, que lo ideal, es permitir a las zonas de los ESX el acceso a los puertos de la EVA del CPD B, así si tuvieramos que pasar la infraestructura a trabajar contra la EVA del CPD B, tendriamos la mitad del trabajo hecho.

Con la configuración de zoning anterior, conseguimos que los CV de ambos CPDs sean capaces de administrar las dos EVAs como se muestra en la imagen.

Lo primero que tendremos que configurar para empezar a replicar, es un DR Group o Data Replication Group. En estos, deberemos agrupar aquellas LUNs del mismo tipo; 就我而言, tengo varias LUN que sirven como DataStores en VMware por lo que crearé un único DRGroup para dichas LUNs.

为此,, pincharemos sobre “Data Replication” 和 “Create Data Replication Group”.

En la primera parte, tenemos el 名字 del DRG, 这 起源 que toma por defecto es la EVA desde donde estas creando el grupo de replicación. 这 命运, marcaremos la EVA a la que queremos replicar… como en mi caso solo tengo dos, no tengo posibilidad a fallo… 这 Source Vdisk, es la LUN que deseamos replicar. (cada LUN solo puede estar en un DRGroup)

En la segunda parte, digamos que tenemos las opciones “avanzadas”:

- Write mode: Mode de escritura, sincrono o asincrono:

- Synchronous. This mode provides the best data protection. In synchronous write mode, the array acknowledges I/O completion after the data is cached on the source and destination arrays. This process maintains identical data on a source DR group and its destination DR group at all times.

- Asynchronous. This mode provides the best host I/O performance. In asynchronous write mode, the source array acknowledges host writes before the data is replicated on the destination array. This process allows faster host I/O than synchronous mode. From a data protection standpoint, there can be brief instances in which the data is not identical in the source and destination DR group. Asynchronous write mode can be 基本 或 enhanced, depending on the controller software version.

- Destination Disk Group: Grupo de discos de destino. 就我而言, como solo tengo una bandeja de discos por EVA, solamente tengo un Disk Group.

- Destination redundancy: Podemos modificar el nivel de RAID del destino o dejar como en el origen…

- Destination host access: podemos establecer el nivel de acceso que tendra la LUN…

- Log Size: Tamaño de LOG. ¡¡OJO!! El tamaño de log por defecto a partir del firm 9.0.0 来自 102,40国标. Los logs se guardan con una redundancia RAID1 y en las dos cabinas asi que ojito con el espacio que teneis disponible… yo lo he establecido en 10240Mb… que me parece más que suficiente.

- Source Log Disk Group: El grupo de disco donde se guarden los LOGs en el origen. Esto podria ser util si tenemos dos grups de discos con diferentes coenxiones. FIBRA frente a FATA por ejemplo.

- Destination Log Disk Group: El grupo de disco donde se guarden los LOGs en el origen.

- Failsafe on unavail member: Failsafe data protection is a feature which blocks host I/O to all of the virtual disks in a DR group when components fail or become unavailable. This feature protects data by maintaining write ordering in the source and destination DR groups. (no hya mejor explicación)…

- Suspend on links down: Suspende la replica si algun link se encuentra en estado Down.

- Suspend on full copy: Si esta ‘enable’ la replicacion remota se suspende cuando se lanza una ‘full copy’.

- comments: No comments…

una vez elegidas las opciones, arriba le pulsaremos sobre “创造” y empezará la primera ‘full copy’. Cuidado cuando lo lanzais puesto que puede repercutir en el rendimiento del sistema…

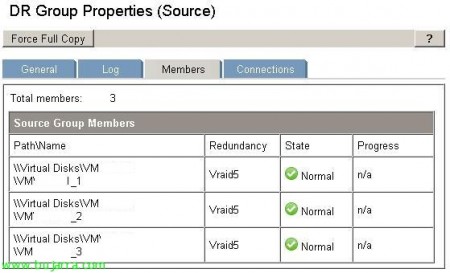

一旦创建并完成了第一个副本, 如果我们选择了同步写入模式,它将持续变化 “源-目标”. 不过, 选择相关的DRGroup并浏览图片中显示的标签页, 我们可以再次更改创建时提供的所有选项. 除此之外还可以查看副本的状态…

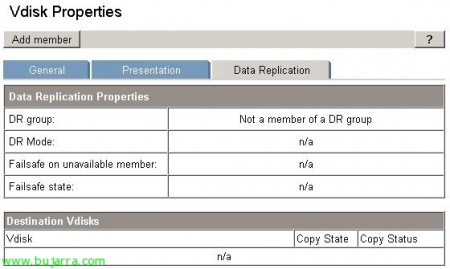

如果我们想向已创建的DRGroup添加一个LUN, 我们必须从LUN的属性中的DataReplication标签页进行操作, 添加成员.

- DR组: 允许我们指明已创建的某个DRG

- 目标磁盘组: 目标磁盘组

- 目标冗余级别: 目标的RAID级别.

我们也可以从这里, 跳转创建一个新的DRG, 点击按钮 “创建DR组”…

Así es como se muestra la pestañana Members de un DRGroup con 3 LUNs replicando.