Replica tra due HP EVA 4400 con Accesso Continuo

Continuous Access, es la replicación nativa de las cabinas HP StorageWorks Enterprise Virtual Array Family (VIGILIA). Veremos la configuración necesaria tanto a livello de Switch de SAN como a livello de Command View (CV) para realizar replicación sincrona o asincrona (dependiento de las ubicaciones por ejemplo).

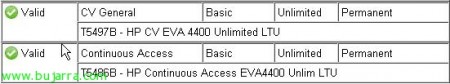

No puedo empezar sin antes mencionar que para realizar este tipo di replicación es necesario disponer de licenciamiento specifico (segun las especificaciones de tu EVA…), Voglio dire, si tenemos una licenza de CV para 4Tb y deseamos replicarlos, deberemos adquirir una licenza de Continuous Access de 4Tb.

Nel mio caso: (licencia ilimitada tanto en CV como en CA 🙂 )

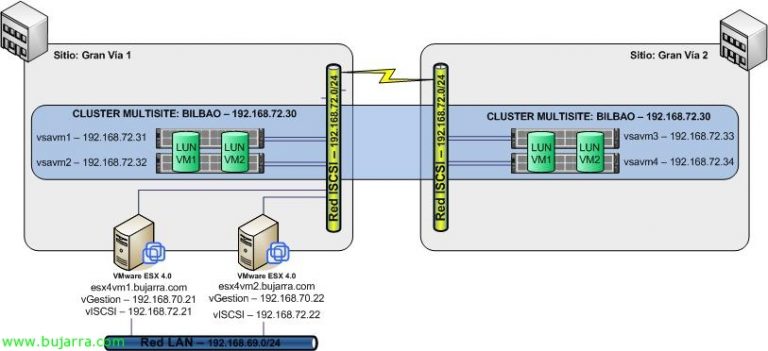

Dicho esto, os presento el entorno a configurar: dos CPDs en un stesso edificio (A, B) con dos switches de fibra en cada uno (11 e 12, 21 e 22). En cada CPD, dos HP EVA's 4400 con un solo grupo de discos (12], HD 300Gb de fibra); Inoltre, un servidor que ejercerá de Command View en cada CPD (CV_A y CV_B) E per finire, una infraestructura de virtualización dividida entre los dos CPDs (4 ESX en CPD A y 2 ESX en CPD B, con un solo vCenter en el servidor CV_A. Todas las fibras van por doble camino a excepción de los dos servidores 'CV’ que disponen de una sola HBA.

Con la infraestructura presentada, lo primo che debemos hacer es configurata correttamente el zoning de los switches de fibra para que los dos CV sean capaces de ver la cabina del CPD contrario. Esto es un requisito para realizar la replicación; así que al finalizar, dispondremos de dos CV da dove possiamo gestire nuestras dos EVAs.

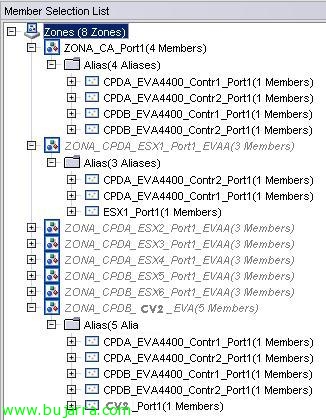

En el Switch 11 (el primero del CPD A), tengo configuradas las siguientes zones:

- ZONA_CA_Port1: È la zona che contiene le porte 1 di entrambi i controller di entrambe le EVA.

- ZONA_CPDA_ESX'x'_Port1_EVAA: È la zona che contiene la prima HBA dell'ESX1 con accesso alle porte 1 di entrambi i controller della EVA del CPD A.

- ZONA_CPDB_CV2_EVA: È la zona dove do i permessi al CV2 alle porte 1 di entrambi i controller di entrambe le EVA.

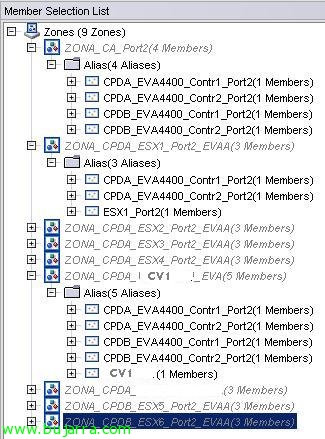

En el Switch 12 (il secondo del CPD A), tengo configuradas las siguientes zones: (Questo switch è quello a cui è collegato il CV1)

- ZONA_CA_Port2: È la zona che contiene le porte 2 di entrambi i controller di entrambe le EVA.

- ZONA_CPDA_ESX'x'_Port2_EVAA: È la zona che contiene la seconda HBA dell'ESX'x’ con accesso alle porte 2 di entrambi i controller della EVA del CPD A.

- ZONA_CPDB_CV1_EVA: È la zona dove do i permessi al CV1 alle porte 2 di entrambi i controller di entrambe le EVA.

En el Switch 21 (il primo del CPD B), tengo configuradas las siguientes zones: (Questo switch è quello a cui è collegato il CV2)

- ZONA_CA_Port1: È la zona che contiene le porte 2 di entrambi i controller di entrambe le EVA.

- ZONA_CPDA_ESX'x'_Port1_EVAA: È la zona che contiene la prima HBA dell'ESX'x’ con accesso alle porte 1 di entrambi i controller della EVA del CPD A.

- ZONA_CPDB_CV2_EVA: È la zona dove do i permessi al CV2 alle porte 2 di entrambi i controller di entrambe le EVA.

En el Switch 22 (il secondo del CPD B), tengo configuradas las siguientes zones:

- ZONA_CA_Port2: È la zona che contiene le porte 2 di entrambi i controller di entrambe le EVA.

- ZONA_CPDA_ESX'x'_Port2_EVAA: È la zona che contiene la prima HBA dell'ESX'x’ con accesso alle porte 2 di entrambi i controller della EVA del CPD A.

- ZONA_CPDB_CV1_EVA: È la zona dove do i permessi al CV1 alle porte 2 di entrambi i controller di entrambe le EVA.

Bisogna menzionare, che l'ideale, permettere alle zone degli ESX l'accesso alle porte della EVA del CPD B, così se dovessimo trasferire l'infrastruttura a lavorare contro la EVA del CPD B, avremmo metà del lavoro fatto.

Con la configurazione di zoning precedente, riusciamo a fare in modo che i CV di entrambi i CPD siano in grado di amministrare le due EVA come mostrato nell'immagine.

La prima cosa che dovremo configurare per iniziare a replicare, è un DR Group o Data Replication Group. In questi, dovremo raggruppare quelle LUN dello stesso tipo; Nel mio caso, ho varie LUN che servono come DataStore in VMware quindi creerò un unico DRGroup per queste LUN.

Per fare ciò,, faremo clic su “Data Replication” e “Create Data Replication Group”.

Nella prima parte, abbiamo il nome del DRG, Le origine que toma por defecto es la EVA desde donde estás creando el grupo de replicación. Le destino, marcaremos la EVA a la que queremos replicar… como en mi caso solo tengo dos, no tengo posibilidad a fallo… Le Source Vdisk, es la LUN que deseamos replicar. (cada LUN solo puede estar en un DRGroup)

En la segunda parte, digamos que tenemos las opciones “avanzadas”:

- Write mode: Mode de escritura, sincrono o asincrono:

- Synchronous. Questa modalità offre la migliore protezione dei dati. In modalità scrittura sincrona, l'array conferma il completamento I/O dopo che i dati sono stati memorizzati in cache sugli array sorgente e destinazione. Questo processo mantiene dati identici su un gruppo DR sorgente e sul suo gruppo DR destinazione in ogni momento.

- Asincrono. Questa modalità fornisce le migliori prestazioni I/O dell'host. In modalità scrittura asincrona, l'array sorgente riconosce le scritture dell'host prima che i dati siano replicati sull'array di destinazione. Questo processo permette un I/O host più veloce rispetto alla modalità sincrona. Dal punto di vista della protezione dei dati, possono esserci brevi istanze in cui i dati non sono identici nel gruppo DR sorgente e destinazione. La modalità di scrittura asincrona può essere Basico o migliorata, a seconda della versione del software del controller.

- Gruppo Disco di Destinazione: Gruppo di dischi di destinazione. Nel mio caso, dato che ho solo un vassoio di dischi per EVA, ho solo un Disk Group.

- Ridondanza di Destinazione: Possiamo modificare il livello di RAID del destino o lasciarlo come nell'origine…

- Accesso host di destinazione: possiamo impostare il livello di accesso che avrà la LUN…

- Dimensione del Log: Dimensione del LOG. ATTENZIONE!! La dimensione del log di default a partire dal firmware 9.0.0 è di 102,40GB. I log vengono salvati con una ridondanza RAID1 e in entrambe le cabine quindi fate attenzione allo spazio disponibile… io l'ho impostato su 10240Mb… che mi sembra più che sufficiente.

- Gruppo di dischi log di origine: Il gruppo di dischi dove vengono salvati i LOG nella sorgente. Questo potrebbe essere utile se abbiamo due gruppi di dischi con connessioni diverse. FIBRA contro FATA per esempio.

- Gruppo di dischi log di destinazione: Il gruppo di dischi dove vengono salvati i LOG nella sorgente.

- Protezione failsafe su membro non disponibile: La protezione dei dati failsafe è una funzione che blocca l'I/O del host su tutti i dischi virtuali in un gruppo DR quando i componenti falliscono o diventano non disponibili. Questa funzione protegge i dati mantenendo l'ordine di scrittura nei gruppi DR di origine e destinazione. (non c'è spiegazione migliore)…

- Sospendi se link giù: Sospende la replica se qualche link è in stato Down.

- Suspend on full copy: Si esta ‘enable’ la replicacion remota se suspende cuando se lanza una ‘full copy’.

- comments: No comments…

una vez elegidas las opciones, arriba le pulsaremos sobre “Creare” y empezará la primera ‘full copy’. Cuidado cuando lo lanzais puesto que puede repercutir en el rendimiento del sistema…

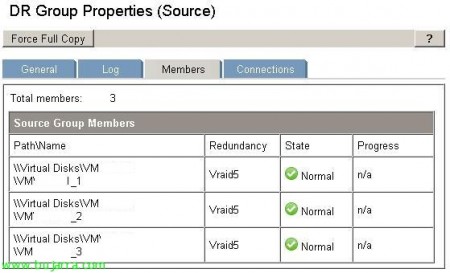

Una vez creado y terminada la primera replica, si hemos seleccionado el modo de escritura sincrono estará en continuo cambio “origen-destino”. Tuttavia, seleccionando el DRGroup en cuestion y navengando por las pestañas que aparecen en la imagen, podemos volver a cambiar todas las opciones que se dan en el momento de su creación. Ademas de ver el estado de la replica…

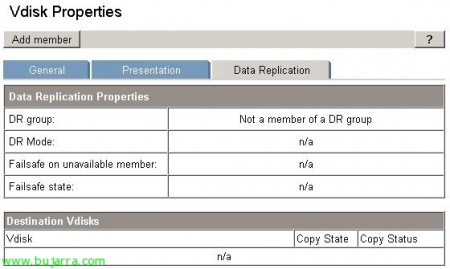

Si quiesieramos añadir una LUN a un DRGroup ya creado, lo tendremos que hacer desde las propiedades de la LUN sobre la pestaña de DataReplication, Add member.

- DR Group: Nos permite indicar algun de los DRG ya creados

- Destination disk group: el grupo de discos de destino

- Destination redundancy level: El nivel de RAID en el destino.

Podriamos tambien desde qui, saltar a crear un DRG nuevo, con el boton “Create DR group”…

Así es como se muestra la pestañana Members de un DRGroup con 3 LUNs replicando.